|

|

下载本文的。pdf格式 这种文件类型包括高分辨率的图形和原理图(如适用)。 |

深度学习,或称深度神经网络(DNNs),是最近的技术热潮。从自动驾驶汽车到给照片加标签,它的目标无所不包。dnn只是众多人工智能(AI)研究领域之一。随着处理器性能的提高,支持更复杂的系统,它变得更加流行。

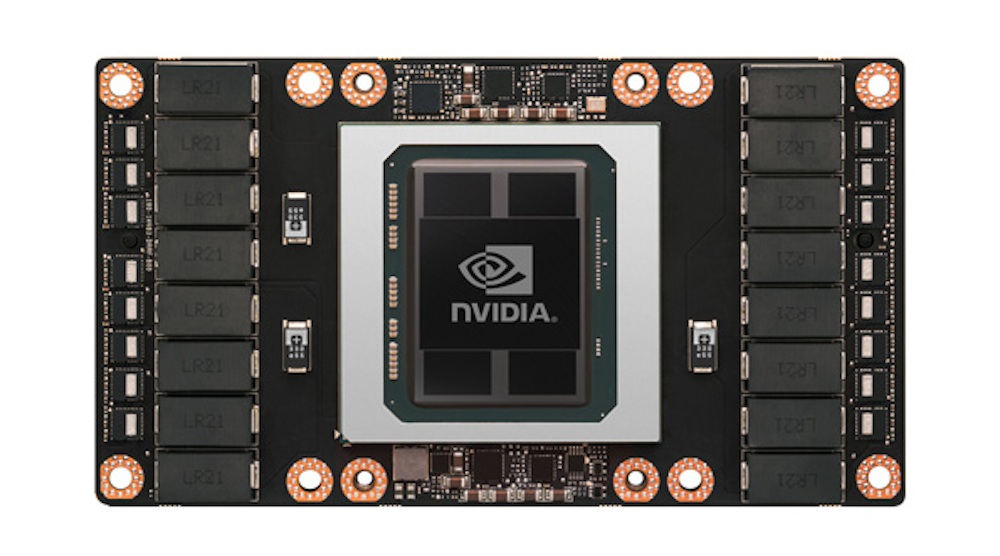

âdnn需要在fpga和gpu中找到的矩阵数字处理能力。gpu现在是许多DNN平台的目标。英伟达特斯拉P100 GPU (图1)旨在解决深度学习神经网络等应用。特斯拉P100可以提供21个16位浮点TFLOPS,这是DNN应用的理想选择。它采用coos (Chip-on - Wafer-on-Substrate)和HBM2 (high bandwidth memory version 2)技术。AMD在其Radeon R9 GPU上使用HBM(见“2015年度最佳:高带宽内存帮助GPU提升性能”在electronicdesign.com上)。特斯拉P100拥有4个nvlink,可以将多个芯片组合成一个计算节点。

英伟达该芯片支持CUDA编程环境。Cuda DNN (cuDNN)运行时的目标是DNN框架,如TensorFlow,一个用于数值计算的开源软件库。你可以看看TensorFlow操场(图2)网站,了解TensorFlow和神经网络是如何通过改变节点和层数等变量来运行的。

DNN不会解决所有的人工智能问题,也不一定是应用程序的灵丹妙药,但它是一个越来越实用的有价值的工具。

寻找零件?去SourceESB.