你将学习:

- 特定领域的AI改变了计算机架构的游戏规则。

- 为什么对神经网络有如此大的需求。

虽然通用处理器长期以来一直占据市场份额,但在科学计算和人工智能(AI)等应用领域,人们正逐步转向将计算周期花费在较新的特定领域处理器上。虽然缺乏良好运行更通用应用程序的能力,但它们通过将特定于市场的应用程序的性能和能效大幅提高多个数量级来弥补这一点。将特定领域的硅用于人工智能,开启了计算机架构的新黄金时代,同时也重振了半导体行业。

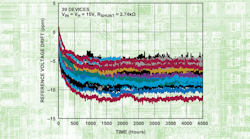

虽然现代人工智能芯片和应用中使用的许多技术已经存在了几十年,但神经网络的使用直到最近才真正兴起(见图).

这张图表提供了一些有趣的见解,解释了为什么人工智能技术在上个世纪80年代和90年代的热潮期间未能起飞。晶体管的密度不够高,无法容纳大规模的并行,内存技术也无法提供足够的速度和容量来训练神经网络模型。因此,更传统的方法优于神经网络。

神经网络的需求

快进到今天,我们看到处理能力提高了大约5个数量级,存储能力提高了3到4个数量级。再加上大量现成的可用于训练机器学习系统的标签数字数据,神经网络已经取代了过去的传统方法。

世界数字数据继续呈指数级增长,保守估计每两到三年数据就会翻一番。数据量的快速增长导致了人工智能的良性循环:更多的数字数据可以实现更精确的神经网络,对神经网络的需求继续增长,因为它们是理解所有这些数据的唯一可行方法之一。新的算法也从我们可用的海量信息中诞生,加快了该领域的创新步伐。

虽然距离上次对神经网络感兴趣的浪潮已经过去了近40年,但很明显,在计算机架构、半导体技术和随时可用的数据的进步的推动下,我们已经开启了人工智能和机器学习历史的新篇章。

展望未来,我们需要更多的性能来解决新问题和不断增长的数据集。几十年来,半导体行业一直依赖摩尔定律(Moore 's Law)和制造技术的改进,以提供更多的晶体管和更快的时钟速度,并依靠登纳德缩放(Dennard Scaling)来提高电力效率。具有讽刺意味的是,就在我们最需要它们的时候,摩尔定律(Moore 's Law)正在放缓,而登纳德缩放(Dennard Scaling)几乎停止了。特定领域的硅和并行使用许多计算引擎提供了急需的性能提升,而挑战将是继续创新,以保持我们在最近几年所享受的历史性的改进速度。

在这个AI记忆系统系列中,我们将探索对新AI架构的兴趣的复苏如何成为特定领域硅设计的催化剂,这反过来又推动了计算机架构的复兴。随着内存带宽成为AI应用的关键资源,内存系统再次成为焦点,成为半导体行业的一部分是一个非常令人兴奋的时刻。